NVLINKH100GPU库存

以优化内存和缓存的使用和性能。H100HBM3和HBM2eDRAM子系统带宽性能H100L2cache采用分区耦合结构(partitionedcrossbarstructure)对与分区直接相连的GPC中的子模块的访存数据进行定位和高速缓存。L2cache驻留控制优化了容量利用率,允许程序员有选择地管理应该保留在缓存中或被驱逐的数据。内存子系统RAS特征RAS:Reliability,Av**lable,Serviceability(可靠性,可获得性)ECC存储弹性(MemoryResiliency)H100HBM3/2e存储子系统支持单纠错双检错(SECDED)纠错码(ECC)来保护数据。H100的HBM3/2e存储器支持"边带ECC",其中一个与主HBM存储器分开的小的存储区域用于ECC位内存行重映射H100HBM3/HBM2e子系统可以将产生错误ECC码的内存单元置为失效。并使用行重映射逻辑将其在启动时替换为保留的已知正确的行每个HBM3/HBM2e内存块中的若干内存行被预留为备用行,当需要替换被判定为坏的行时可以被。第二代安全MIGMIG技术允许将GPU划分为多达7个GPU事件(instance),以优化GPU利用率,并在不同客户端(例如VM、容器和进程等)之间提供一个被定义的QoS和隔离,在为客户端提供增强的安全性和保证GPU利用率之外,还确保一个客户端不受其他客户端的工作和调度的影响。H100 GPU 提供高精度计算支持。NVLINKH100GPU库存

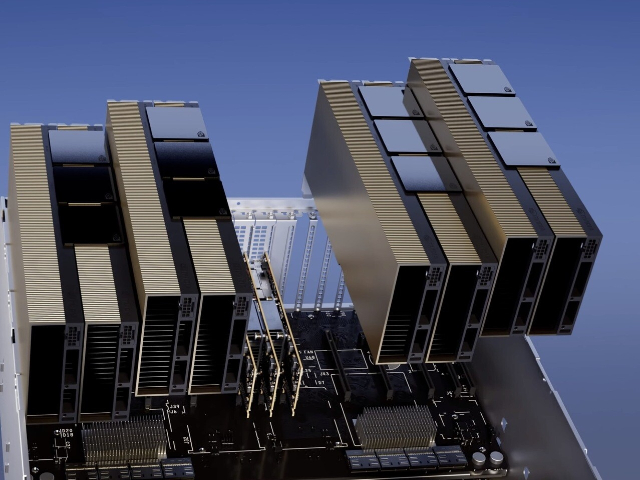

可以在多个计算节点上实现多达256个GPU之间的GPU-to-GPU通信。与常规的NVLink(所有GPU共享一个共同的地址空间,请求直接使用GPU的物理地址进行路由)不同,NVLink网络引入了一个新的网络地址空间,由H100中新的地址转换硬件支持,以隔离所有GPU的地址空间和网络地址空间。这使得NVLink网络可以安全地扩展到更多的GPU上。由于NVLink网络端点不共享一个公共的内存地址空间,NVLink网络连接在整个系统中并不是自动建立的。相反,与其他网络接口(如IB交换机)类似,用户软件应根据需要显式地建立端点之间的连接。第三代NVSwitch包括驻留在节点内部和外部的交换机,用于连接服务器、集群和数据中心环境中的多个GPU。节点内部每一个新的第三代NVSwitch提供64个端口。NVLinklinks交换机的总吞吐率从上一代的Tbits/sec提高到Tbits/sec。还通过多播和NVIDIASHARP网内精简提供了集群操作的硬件加速。加速集群操作包括写广播(all_gather)、reduce_scatter、广播原子。组内多播和缩减能提供2倍的吞吐量增益,同时降低了小块大小的延迟。集群的NVSwitch加速降低了用于集群通信的SM的负载。新的NVLink交换系统新的NVLINK网络技术和新的第三代NVSwitch相结合。广东H100GPU折扣购买 H100 GPU 享受限时特价。

英伟达可以纯粹提高价格以找到清算价格,并且在某种程度上正在这样做。但重要的是要知道,终H100的分配取决于Nvidia更喜欢将分配分配给谁。供应H100显卡#造成瓶颈的原因-供应生产方面的瓶颈是什么?哪些组件?谁生产它们?谁制造了H100?#台积电。英伟达可以使用其他芯片厂进行H100生产吗?#不是真的,至少现在还没有。他们过去曾与三星合作过。但在H100和其他5nmGPU上,他们只使用台积电。这意味着三星还不能满足他们对前列GPU的需求。他们将来可能会与英特尔合作,并再次与三星合作,但这些都不会在短期内以有助于H100供应紧缩的方式发生。不同的台积电节点如何关联?#台积电5nm系列:N5264N要么适合作为N5的增强版本,要么低于N5PN5P4N要么适合作为N5P的增强版本,要么低于N5作为N5的增强版本N4N4PH100是在哪个台积电节点上制造的?#台积电4N。这是Nvidia的一个特殊节点,它属于5nm系列,并且是增强的5nm,而不是真正的4nm。还有谁使用该节点?#是苹果,但他们主要转向N3,并保留了大部分N3容量。高通和AMD是N5家族的其他大客户。A100使用哪个台积电节点?#N727晶圆厂产能通常提前多久预留?#不确定,虽然可能是12+个月。

我们将定期举办技术交流会和培训,帮助客户更好地了解和使用 H100 GPU 产品。通过与客户的面对面交流,ITMALL.sale 不仅能够分享新的技术和产品信息,还能够深入了解客户的需求和挑战。ITMALL.sale 的技术前辈会在交流会上详细讲解 H100 GPU 的使用方法和最佳实践,解答客户的技术问题,并提供实用的建议和解决方案,帮助客户充分发挥 H100 GPU 的性能,提升业务效率。ITMALL.sale 的技术交流会不仅是客户学习和提升的机会,也是客户与行业前辈交流和合作的平台,促进技术进步和创新发展。H100 GPU 适用于企业级应用。

H100 GPU 在边缘计算中的应用也非常多。其高性能计算能力和低功耗设计使其非常适合用于边缘计算。H100 GPU 的强大并行处理能力可以高效处理实时数据,提升应用的响应速度和可靠性。无论是在智能制造、智慧城市还是物联网应用中,H100 GPU 都能提升数据处理效率,满足边缘计算的需求。其紧凑设计和高能效比为边缘计算设备提供了理想的硬件支持,是边缘计算领域的重要组成部分。

在游戏开发领域,H100 GPU 提供了强大的图形处理能力和计算性能。它能够实现复杂和逼真的游戏画面,提高游戏的视觉效果和玩家体验。H100 GPU 的并行处理单元可以高效处理大量图形和物理运算,减少延迟和卡顿现象。对于开发者来说,H100 GPU 的稳定性和高能效为长时间的开发和测试提供了可靠保障,助力开发者创造出更具创意和吸引力的游戏作品,是游戏开发的理想选择。 H100 GPU 限时降价,机会不容错过。40GH100GPU优惠

H100 GPU 提供高效的视频编辑支持。NVLINKH100GPU库存

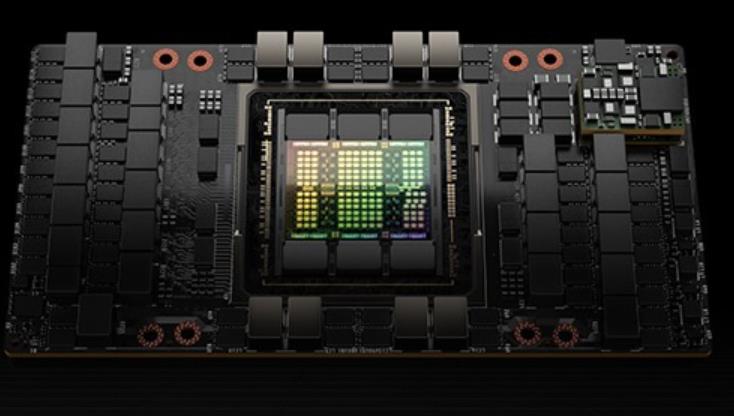

基于H100的系统和板卡H100SXM5GPU使用NVIDIA定制的SXM5板卡内置H100GPU和HMB3内存堆栈提供第四代NVLink和PCIeGen5连接提供高的应用性能这种配置非常适合在一个服务器和跨服务器的情况下将应用程序扩展到多个GPU上的客户,通过在HGXH100服务器板卡上配置4-GPU和8-GPU实现4-GPU配置:包括GPU之间的点对点NVLink连接,并在服务器中提供更高的CPU-GPU比率;8-GPU配置:包括NVSwitch,以提供SHARP在网络中的缩减和任意对GPU之间900GB/s的完整NVLink带宽。H100SXM5GPU还被用于功能强大的新型DGXH100服务器和DGXSuperPOD系统中。H100PCIeGen5GPU以有350W的热设计功耗(ThermalDesignPower,TDP),提供了H100SXM5GPU的全部能力该配置可选择性地使用NVLink桥以600GB/s的带宽连接多达两个GPU,接近PCIeGen5的5倍。H100PCIe非常适合主流加速服务器(使用标准的架构,提供更低服务器功耗),为同时扩展到1或2个GPU的应用提供了很好的性能,包括AIInference和一些HPC应用。在10个前列数据分析、AI和HPC应用程序的数据集中,单个H100PCIeGPU**地提供了H100SXM5GPU的65%的交付性能,同时消耗了50%的功耗。DGXH100andDGXSuperPODNVIDIADGXH100是一个通用的高性能人工智能系统。NVLINKH100GPU库存

下一篇: N9K-C9500-RMK 货期